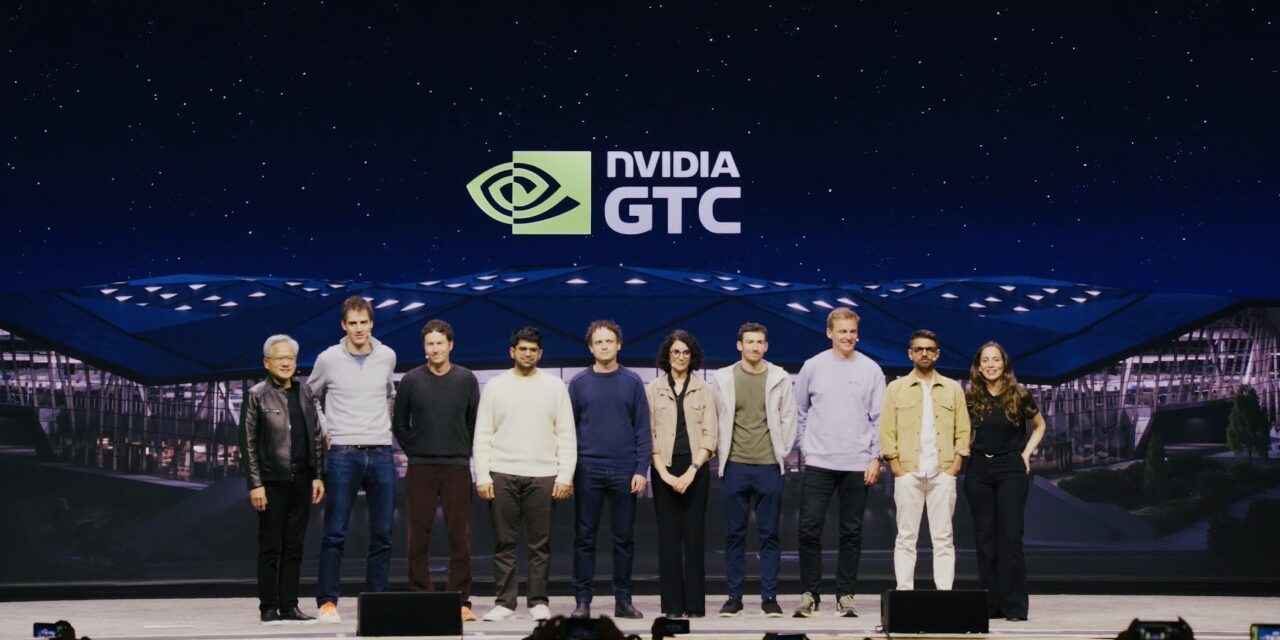

GTC 2026,Jensen Huang召集了一场含金量极高的圆桌。

同台的是LangChain、Perplexity、Cursor、Mistral、Thinking Machines Lab等十几家公司的CEO。他们聊的不是OpenAI和Anthropic,而是一个更根本的问题——前沿大模型之外,AI真正的样子是什么?

整场对话,没有一个CEO在比参数、比benchmark。

他们谈的是:系统怎么设计、Agent怎么治理、开源生态如何演化、算力基础设施如何被共享。这些话题没有前者性感,但可能更接近AI的真实走向。

1. AI不等于大模型

AI是一个完整的系统:多个模型、推理引擎、工具调用、记忆机制、文件系统……缺了任何一个,都不叫AI。很多人把AI等同于LLM,这是根本性误解。这个认知框架,决定了你怎么看整个行业。

LangChain CEO Harrison Chase说,大家以为AI行业只有两类公司:造大模型的,和在大模型上做应用的。

但第三类正在成型:它们既调用外部最好的API,也自己训练专有模型,把两者融合成某个垂直领域最好的产品。

3. “Harness Engineering”是新的核心战场

围绕模型构建的运行框架——上下文怎么压缩、用哪些子代理、给模型哪些工具——正在成为独立的工程学科。

Harrison Chase直接说:Claude Code的竞争力,不只来自模型好,很大程度上来自harness设计得好。模型以外的部分,正在成为真正的差异化战场。

∙ 生成式AI——让模型能生成Token,推理才成为可能

三者缺一不可,每一层都是下一层的前提。我们现在站在第三次跃迁的起点,而这次跃迁会向所有垂直行业同时扩散。

5. OpenClaw:第一台真正意义上的AI计算机

Jensen给OpenClaw(Anthropic开源的Agentic框架)的定位很高——它第一次把”AI是一台新型计算机”这件事,用完整开源的方式呈现给了世界。

工作记忆、文件系统、任务调度、网络通信、通用API……它不是聊天机器人,它是计算机。

Perplexity CEO Arvind给出了一个后见之明里极其简洁的洞察:

当模型学会操作命令行和代码沙箱之后,只要每个工具都有CLI接口,图形界面就不再是必需的。一个为编程优化的模型,突然就能处理所有知识工作。

Coding Agent的能力泛化,不是因为”代码=万能”,而是因为命令行就是通向一切的接口。

LangChain CEO Harrison Chase从OpenClaw总结出三个首次在消费级产品大规模出现的特征:

∙Always-on:不等你问,主动推送。每10分钟跑一次的Agent,你才会真正开始在意成本——这正是开源模型的机会所在

∙Agent Identity:Agent需要独立账号,不能和人类用同一套权限

∙Memory:它记得历史,还能通过修改自己的代码来更新自己的行为规则

未来高性能Agent不依赖一个模型,而是把工作路由到最合适的模型:通用API的computer use能力 + 垂直领域的专有模型,组合上限将超过任何单一模型。

Jensen说得很清楚:这不是零和博弈。闭源模型是”王冠上的明珠”,开源模型将成为Agentic系统里不可或缺的组件。即使最封闭的模型公司,在构建完整系统时,也会大量用到开源模型。

Amp CEO Anj的论证很有力:当AI进入医疗、国防、关键基础设施,你必须能”内省”它、审计它、自主部署它。把信任委托给第三方API,在高风险场景里是不可接受的。开源模型,是建立信任最快的路径。

Open Evidence CEO Daniel Nader说:最好的医院之所以卓越,不是因为有最好的全科医生,而是因为有世界级的心脏科、神经科、肿瘤科医生。

AI的未来形态会镜像社会的专业化分工。“平均了所有专业能力的通用模型”,只会是一个平庸的智能。 构建专业化AI的起点,必然是可深度定制的开源基础模型。

Anj用工业革命做了一个印象深刻的类比:1800年代的工厂主都在囤积蒸汽机,每家自建,过度供给却低效利用。

这正是今天AI算力基础设施的现状。解决方案不是每家自建算力孤岛,而是建立“AI电网”——共享、弹性、开放的算力基础设施。开放模型要在前沿持续发展,必须有开放基础设施配套。

Jensen说了一个被严重低估的预测:三年前,预训练占训练算力的90%。未来,这个比例将大幅逆转,后训练(强化学习、专业化微调、人类反馈)将占主导。

价值创造的重心,正从”谁有更多数据”转向“谁能做更好的后训练”。

Thinking Machines Lab CEO Mira Murati(前OpenAI CTO)用AlphaGo举例:6000万参数,打败世界围棋冠军。核心不是规模,是强化学习让模型持续学习。

当RL开始在语言模型上工作,AI的能力边界就变成了纯粹的经济学问题:你愿意花多少钱攻克某个科学难题?

Amp CEO Anj说出了过去一年最重要的产业发现:Revenue scales with Compute——收入随算力可预测地线性扩展。

Coding领域已经验证了这条定律。Mistral、Black Forest Labs、Open Evidence代表的,是下一批等待验证的新边疆。

Jensen补了一句:“买的算力越多,赚的钱越多。记住这句话。”

Open Evidence CEO Daniel Nader给了一个极其具体的场景:美国医生的大量时间,被保险预授权信函和拒赔申诉消耗。

凌晨3点,患者被保险公司拒约,医生在睡觉。而Agent可以自动检索病历、撰写申诉、推动审批。

Black Forest Labs CEO Robin提醒:当所有人聚焦于代码能力时,视觉智能正在悄然突破。

从文本生图,到视频生成,到与物理世界交互的机器人视觉——视觉模型将驱动制造业、内容创作、物理AI。这个赛道的输出范式和代码完全不同,需要完全不同的思考框架。

Mistral CEO Arthur Mensch说:个人用AI Agent很简单,企业部署的核心挑战是治理,不是技术。

Jensen将其压缩成一条安全原则:Agent有三种能力——访问敏感数据、执行代码、对外通信。除了最高负责人,任何Agent在任何时候,最多只能同时被授权其中两种。

AI2研究负责人Hannah强调:开源最大的价值,不是最终模型权重,而是完整的开发流程——训练数据、中间检查点、基础设施代码,全都开放。

这让全球研究者可以在任意阶段介入。混合模型架构优于纯Transformer的理论突破,就是这种开放生态的直接产物。

Reflection CEO Misha Laskin总结:AI的进步速度太快,仅靠少数大型实验室覆盖不了所有方向。开放API、开放模型、开放数据、开放研究发现,让全球聪明人都能参与进来。

这不是商业上的妥协,这是加速科学进步最有效的方式。

从这场对话中可以看到,AI 最重要的竞争,已经不在模型层了。

大模型更像基础设施,像电网——真正被持续投资和重构的,是电网之上的“插座”。

Harness 工程、垂直模型、企业 Agent 治理、开放算力基础设施……这些方向都还早、还在演化,也还没有公认的赢家。

但也正因为如此,才更值得认真对待。

真正的机会,往往不在答案已经清晰的地方,而是在问题刚刚被重新定义的时候。

世界領袖论坛"探讨GTC峰會在紐約專場隆重举办圆滿成功 3/19